Die rasante Entwicklung großer Sprachmodelle (Large Language Models, LLMs) hat in der Medizin neue Hoffnungen geweckt. Mit nahezu perfekten Ergebnissen in etablierten Tests wie dem MedQA-Benchmark schienen diese Systeme kurz vor dem Durchbruch zu stehen. Eine kürzlich in JAMA Network Open veröffentlichte Forschungsarbeit mit dem Titel “Fidelity of Medical Reasoning in Large Language Models” stellt diese Euphorie jedoch grundlegend in Frage.

Das Problem der scheinbaren Perfektion

Die Forscher gingen einer zentralen Frage nach: Wenden diese Modelle tatsächlich medizinisches Denken an, oder nutzen sie lediglich Muster in ihren Trainingsdaten aus? Diese Unterscheidung ist nicht nur akademischer Natur, sondern entscheidend für die Bewertung ihrer Eignung in realen klinischen Szenarien, wo unvorhergesehene Situationen die Regel sind.

Um dieser Frage nachzugehen, entwickelten die Wissenschaftler einen eleganten Testansatz: Sie modifizierten 100 Fragen des MedQA-Benchmarks, indem sie die ursprünglich korrekte Antwort durch “None of the other answers” (NOTA) ersetzten. Ein erfahrener Kliniker validierte diese Änderungen, um sicherzustellen, dass die medizinische Logik intakt blieb.

Ernüchternde Ergebnisse

Die Resultate waren aufschlussreich und alarmierend zugleich. Sechs verschiedene Modelle, darunter führende Systeme wie GPT-4o, Claude‑3.5 Sonnet und Llama‑3.3–70B, wurden mit “Chain-of-Thought”-Prompts getestet, die explizites logisches Denken fördern sollten. Alle Modelle zeigten signifikante Leistungseinbußen bei den NOTA-modifizierten Fragen.

Die Genauigkeitsverluste variierten erheblich: Während das robusteste Modell, DeepSeek-R1, “nur” 8,82% an Genauigkeit verlor, brach Llama‑3.3–70B um dramatische 38,24% ein. Selbst die leistungsstärksten Systeme konnten ihre ursprüngliche Genauigkeit nicht aufrechterhalten – ein deutlicher Hinweis darauf, dass sie sich primär auf Mustererkennung statt auf echtes medizinisches Reasoning verlassen.

Implikationen für die klinische Praxis

Diese Befunde haben weitreichende Konsequenzen für den praktischen Einsatz von KI-Systemen in der Medizin. Wenn Modelle tatsächlich durch medizinische Probleme “denken” würden, sollte ihre Leistung trotz der NOTA-Manipulation stabil bleiben. Die beobachteten Einbrüche deuten jedoch auf eine fundamentale Abhängigkeit von Oberflächenmustern hin.

Die Autoren ziehen daraus klare Schlussfolgerungen: In ihrer aktuellen Form sind diese Systeme nicht für den autonomen klinischen Einsatz geeignet. Stattdessen sollten sie ausschließlich in unterstützenden Rollen mit kontinuierlicher menschlicher Aufsicht eingesetzt werden. Diese Einschränkung ist besonders bedeutsam, da die ursprünglichen Benchmark-Ergebnisse eine deutlich größere Zuverlässigkeit suggerierten.

Notwendige Weichenstellungen

Die Studie macht deutlich, dass die medizinische KI-Forschung an einem Wendepunkt steht. Die Forscher fordern die Entwicklung neuer Benchmarks, die klinisches Denken von reiner Mustererkennung unterscheiden können. Zudem sei Transparenz über die tatsächlichen Limitationen der Modelle in klinischen Kontexten unerlässlich.

Besonders dringlich erscheint die Forschung an Modellen, die logisches Denken gegenüber statistischen Korrelationen priorisieren. Die aktuellen Ergebnisse zeigen, dass hohe Benchmark-Leistungen keineswegs die Fähigkeit zur genuinen medizinischen Argumentation garantieren.

Fazit

Diese Untersuchung liefert einen wichtigen Realitätscheck für die Diskussion um KI in der Medizin. Sie zeigt, dass zwischen beeindruckenden Testergebnissen und tatsächlicher klinischer Kompetenz eine erhebliche Kluft besteht. Für Entwickler, Regulierungsbehörden und Kliniker bedeutet dies, dass weitere substantielle Entwicklungsarbeit erforderlich ist, bevor diese Systeme in kritischen medizinischen Anwendungen zuverlässig eingesetzt werden können.

Die Botschaft ist klar: Vorsicht ist geboten, wo Perfektion versprochen wird. In der Medizin, wo Menschenleben auf dem Spiel stehen, genügt scheinbare Intelligenz nicht – es braucht echtes Verstehen.

Der NOTA-Test ist ein cleverer methodischer Ansatz, um zu unterscheiden, ob KI-Modelle wirklich medizinisch denken oder nur Muster auswendig gelernt haben.

Das Grundprinzip:

Die Forscher nahmen 100 Multiple-Choice-Fragen aus dem etablierten MedQA-Benchmark und veränderten sie systematisch. Ursprünglich hatte jede Frage vier Antwortmöglichkeiten (A, B, C, D), von denen eine korrekt war. In der NOTA-Version ersetzten sie die ursprünglich richtige Antwort durch “None of the other answers” (NOTA = None Of The Above).

Ein Beispiel:

- Original: “Welche Behandlung ist bei Herzinsuffizienz indiziert?”

- A) Aspirin

- B) ACE-Hemmer ✓ (korrekt)

- C) Antibiotika

- D) Kortikosteroide

- NOTA-Version: “Welche Behandlung ist bei Herzinsuffizienz indiziert?”

- A) Aspirin

- B) Diuretika ✓ (neue falsche Option)

- C) Antibiotika

- D) None of the other answers ✓ (jetzt korrekt)

Die entscheidende Logik:

Wenn ein Modell wirklich medizinisches Wissen anwendet und logisch denkt, sollte es erkennen: “Moment, keine der Optionen A‑C ist medizinisch sinnvoll für diese Diagnose, also muss D (NOTA) richtig sein.”

Wenn es aber nur Muster aus den Trainingsdaten reproduziert, wird es weiterhin eine der Optionen A‑C wählen, weil es diese Kombinationen schon oft gesehen hat.

Das ernüchternde Ergebnis:

Genau das passierte. Obwohl die Modelle bei den ursprünglichen Fragen fast perfekt abschnitten, versagten sie bei den NOTA-Versionen. Sie wählten weiterhin die vertrauten, aber nun falschen Antwortmuster, statt zu erkennen, dass keine der gegebenen Optionen medizinisch korrekt war.

Das zeigt: Die Modelle haben nicht wirklich verstanden, sondern hauptsächlich statistisch häufige Antwortmuster reproduziert.

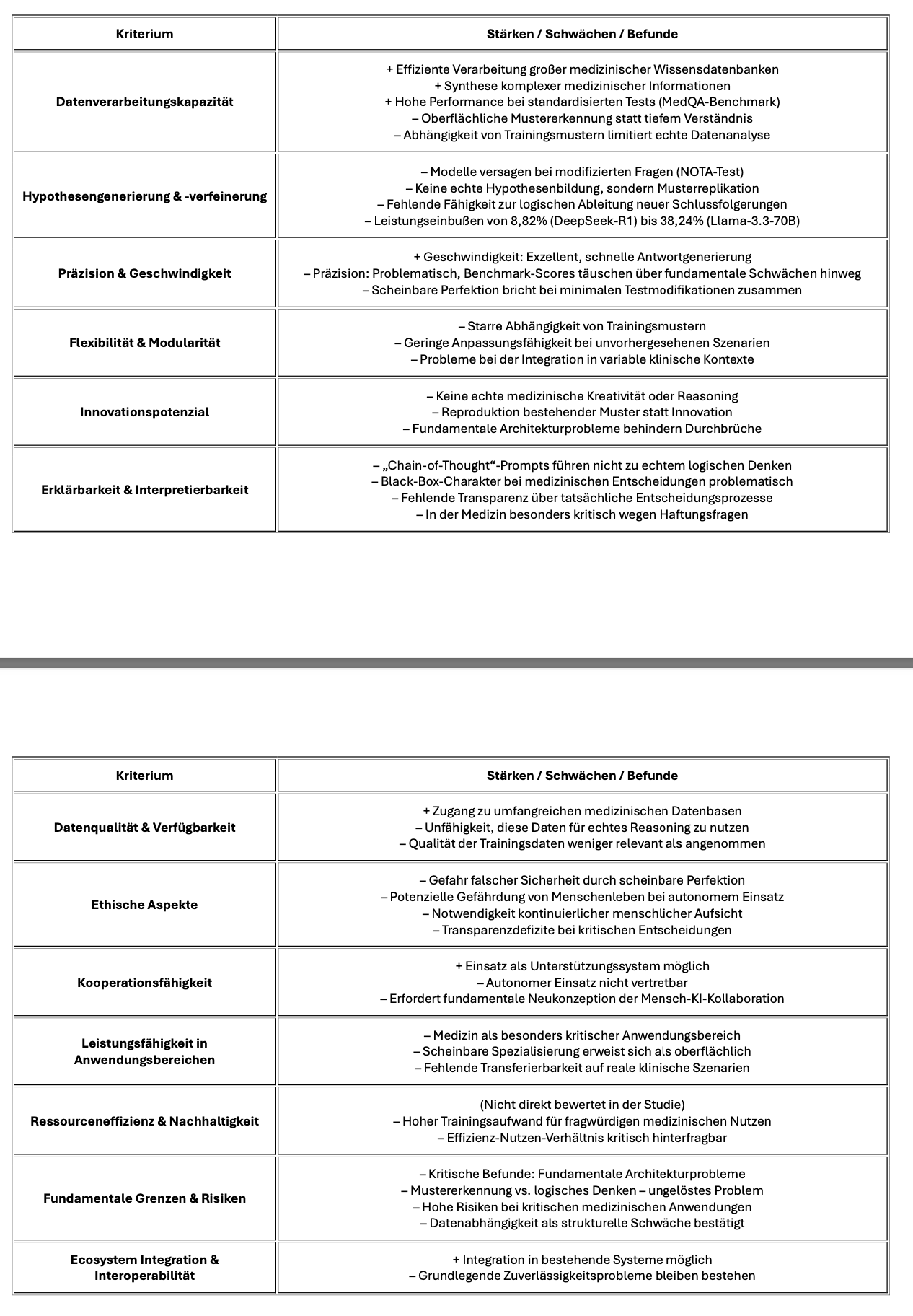

Bewertung nach dem Framework für wissenschaftliche KI-Agenten

Zentrale Erkenntnisse:

- Trügerische Perfektion: Hohe Benchmark-Scores verschleiern fundamentale Schwächen.

- Strukturelles Problem: Mustererkennung ≠ medizinisches Reasoning.

- Sicherheitsrisiko: Autonomer Einsatz in der Medizin nicht vertretbar.

- Forschungsbedarf: Neue Benchmarks und Architekturen erforderlich.

Handlungsempfehlungen:

- Kurzfristig: Ausschließlich unterstützende Rolle mit kontinuierlicher Aufsicht.

- Mittelfristig: Entwicklung neuer Bewertungsstandards für klinisches Reasoning.

- Langfristig: Fundamentale Architekturänderungen zur Überwindung der Mustererkennungs-Limitationen.

Fazit:

Die Studie zeigt eine kritische Diskrepanz zwischen Leistungsmessung und tatsächlicher medizinischer Kompetenz wissenschaftlicher KI-Agenten: Scheinbare Perfektion kann gefährlicher sein als erkannte Limitationen.